NVIDIA vừa thông báo về một dịch vụ Vi tạo sinh AI cho phép doanh nghiệp kết nối các mô hình ngôn ngữ lớn tùy chỉnh với dữ liệu doanh nghiệp để cung cấp các phản hồi cực kỳ chính xác cho các ứng dụng AI của họ.

NVIDIA NeMo Retriever — một dịch vụ mới trong gia đình các khung và công cụ NVIDIA NeMo để xây dựng, tùy chỉnh và triển khai các mô hình generative AI — giúp các tổ chức nâng cao các ứng dụng generative AI của họ với khả năng khai thác thế hệ doanh nghiệp retrieval-augmented generation (RAG) cấp doanh nghiệp.

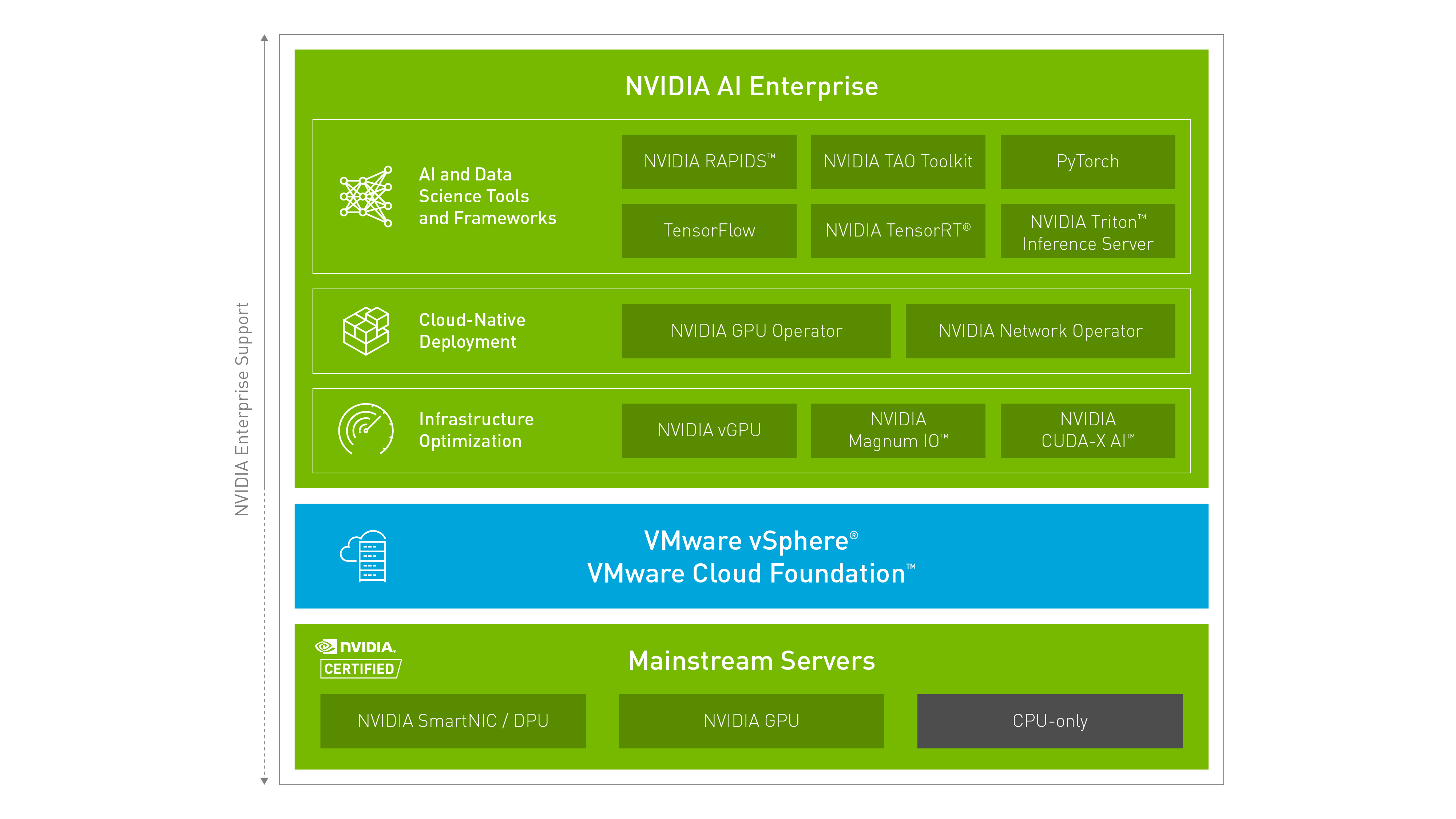

Là một dịch vụ micro generative AI cho phép doanh nghiệp, NeMo Retriever giúp các ứng dụng generative AI cung cấp các phản hồi chính xác hơn thông qua các thuật toán được tối ưu hóa bởi NVIDIA. Những người phát triển sử dụng dịch vụ này có thể kết nối ứng dụng AI của họ với dữ liệu doanh nghiệp ở bất kỳ đâu trên các đám mây và trung tâm dữ liệu. Nó thêm khả năng RAG được tối ưu hóa bởi NVIDIA vào các công ty sản xuất AI và là một phần của nền tảng phần mềm NVIDIA AI Enterprise, có sẵn trên AWS Marketplace.

Cadence, Dropbox, SAP và ServiceNow là những công ty đầu tiên đang hợp tác với NVIDIA để tích hợp khả năng RAG sẵn sàng cho sản xuất vào các ứng dụng và dịch vụ generative AI tùy chỉnh của họ.

“Các ứng dụng generative AI với khả năng RAG là ứng dụng tiếp theo quan trọng của doanh nghiệp,” Jensen Huang, người sáng lập và CEO của NVIDIA nói. “Với NVIDIA NeMo Retriever, các nhà phát triển có thể tạo ra các chatbot, cộng sự và công cụ tạo sinh AI tùy chỉnh có thể truy cập vào dữ liệu doanh nghiệp của họ để biến đổi năng suất với thông tin AI tạo sinh chính xác và có giá trị.”

Các Doanh Nghiệp Hàng Đầu Nâng Cao Độ Chính Xác của LLM Với NeMo Retriever Cadence, một công ty hàng đầu trong việc thiết kế hệ thống điện tử, phục vụ các công ty trong các lĩnh vực tính toán quy mô lớn, truyền thông 5G, ô tô, di động, hàng không vũ trụ, tiêu dùng và y tế. Họ đang hợp tác với NVIDIA để phát triển các tính năng RAG cho các ứng dụng AI tạo sinh trong thiết kế điện tử công nghiệp.

“AI tạo sinh giới thiệu các phương pháp sáng tạo để giải quyết nhu cầu của khách hàng, chẳng hạn như các công cụ để phát hiện ra các khuyết điểm tiềm ẩn sớm trong quy trình thiết kế,” Anirudh Devgan, Chủ tịch và CEO của Cadence biết. “Những nhà nghiên cứu của chúng tôi đang hợp tác với NVIDIA để sử dụng NeMo Retriever để tăng cường độ chính xác và sự liên quan của các ứng dụng AI tạo sinh để phát hiện các vấn đề và giúp khách hàng đưa sản phẩm chất lượng cao lên thị trường nhanh hơn.”

Giải Mã Mã Để Có Các Ứng Dụng Generative AI Chính Xác

Không giống như các bộ công cụ RAG mã nguồn mở, NeMo Retriever hỗ trợ AI tạo sinh sẵn sàng cho sản xuất với các mô hình có khả năng thương mại, ổn định API, các bản vá bảo mật và hỗ trợ doanh nghiệp.

Các thuật toán được tối ưu hóa bởi NVIDIA làm cho Retriever có kết quả độ chính xác cao nhất trong các mô hình nhúng. Các mô hình nhúng được tối ưu hóa này ghi lại mối quan hệ giữa các từ, cho phép LLMs xử lý và phân tích dữ liệu văn bản.

Sử dụng NeMo Retriever, các doanh nghiệp có thể kết nối LLMs của họ với nhiều nguồn dữ liệu và cơ sở kiến thức, để người dùng có thể dễ dàng tương tác với dữ liệu và nhận câu trả lời chính xác, cập nhật bằng các câu hỏi đơn giản, trò chuyện. Các doanh nghiệp sử dụng các ứng dụng được trang bị Retriever có thể cho phép người dùng truy cập thông tin an toàn trên nhiều dạng dữ liệu, chẳng hạn như văn bản, PDF, hình ảnh và video.

Các doanh nghiệp có thể sử dụng NeMo Retriever để đạt được kết quả chính xác hơn với ít sự đào tạo hơn, giúp giảm thời gian ra thị trường và hỗ trợ hiệu suất năng lượng trong việc phát triển các ứng dụng AI tạo sinh.

Triển Khai Đáng Tin Cậy, Đơn Giản, An Toàn Với NVIDIA AI Enterprise

Các công ty có thể triển khai các ứng dụng được trang bị NeMo Retriever để chạy trong quá trình suy luận trên máy tính được tăng cường bởi NVIDIA trên bất kỳ trung tâm dữ liệu hoặc đám mây nào. NVIDIA AI Enterprise hỗ trợ suy luận hiệu suất cao với NVIDIA NeMo, NVIDIA Triton Inference Server, NVIDIA TensorRT, NVIDIA TensorRT-LLM và các phần mềm AI NVIDIA khác.

Để tối ưu hóa hiệu suất suy luận, các nhà phát triển có thể chạy mô hình của họ trên NVIDIA GH200 Grace Hopper Superchips với phần mềm TensorRT-LLM. Các nhà phát triển có thể đăng ký để truy cập sớm vào NVIDIA NeMo Retriever.