NVIDIA công bố DGX Spark, nền tảng máy trạm AI mới hướng tới việc phát triển và vận hành các hệ thống AI agent tự động. Hệ thống được thiết kế để xử lý workload phức tạp và mô hình AI quy mô lớn.

Sự phát triển nhanh của các hệ thống AI agent đang tạo ra một lớp workload mới trong lĩnh vực trí tuệ nhân tạo. Không giống các ứng dụng AI truyền thống chỉ thực hiện một tác vụ đơn lẻ, AI agent thường phải quản lý nhiều tiến trình đồng thời, thực hiện các nhiệm vụ kéo dài và tương tác qua nhiều kênh giao tiếp để tìm giải pháp tối ưu.

Theo NVIDIA, các agent tự động thường phải liên tục thử nghiệm nhiều phương án, khởi chạy các tiến trình nền và xử lý lượng dữ liệu lớn trước khi đưa ra kết quả cuối cùng. Mô hình hoạt động này khiến nhu cầu về năng lực tính toán tăng mạnh, đặc biệt trong các môi trường phát triển cục bộ nơi nhà nghiên cứu và lập trình viên xây dựng hệ thống AI mới.

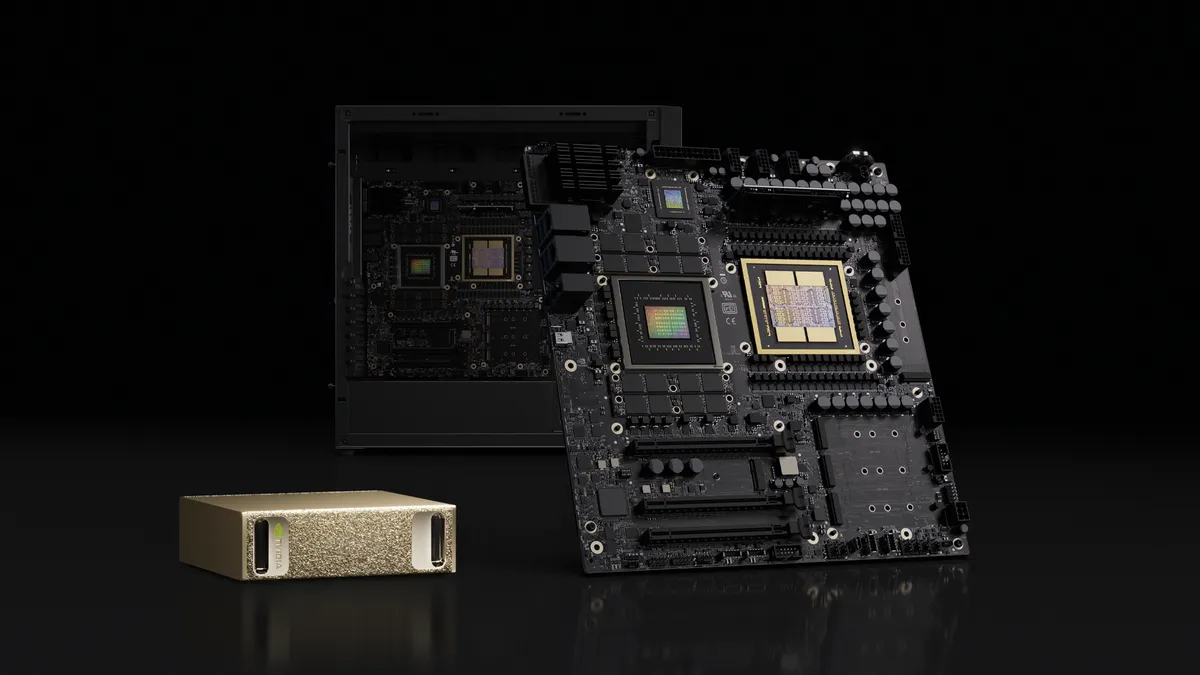

Trong bối cảnh đó, NVIDIA giới thiệu DGX Spark như một nền tảng máy trạm được tối ưu cho việc phát triển và triển khai các workflow AI agent phức tạp. Hệ thống được xây dựng trên kiến trúc Grace Blackwell Superchip, hướng tới việc cung cấp năng lực tính toán đủ mạnh để xử lý các workload AI hiện đại ngay tại môi trường làm việc của nhà phát triển.

AI agent tạo ra nhu cầu tính toán mới cho hệ thống AI

AI agent được xem là một bước tiến tiếp theo của các hệ thống trí tuệ nhân tạo. Thay vì chỉ phản hồi yêu cầu của người dùng, các agent có thể tự lập kế hoạch, thử nghiệm phương án và điều phối nhiều tác vụ để hoàn thành mục tiêu được giao.

Quá trình này thường bao gồm nhiều bước như thu thập dữ liệu, chạy mô hình suy luận, đánh giá kết quả trung gian và tiếp tục thử nghiệm các phương án khác nhau. Trong nhiều trường hợp, các agent cũng có thể phối hợp theo mô hình đa tác nhân (multi-agent), nơi nhiều hệ thống AI tương tác với nhau để giải quyết một vấn đề phức tạp.

Cách vận hành này tạo ra workload đòi hỏi khả năng xử lý song song cao, dung lượng bộ nhớ lớn và độ trễ thấp giữa các thành phần tính toán. Các hệ thống AI truyền thống hoặc máy trạm thông thường khó đáp ứng hiệu quả khi số lượng agent và quy mô mô hình tăng lên.

NVIDIA cho rằng những đặc điểm này khiến các nền tảng tính toán dành riêng cho AI agent trở thành yếu tố quan trọng trong giai đoạn phát triển tiếp theo của ngành AI. DGX Spark được thiết kế nhằm đáp ứng yêu cầu đó bằng cách kết hợp phần cứng chuyên dụng và hệ sinh thái phần mềm AI của hãng.

DGX Spark được thiết kế cho workflow AI agent và mô hình lớn

DGX Spark được tối ưu để chạy các workflow AI agent với khối lượng xử lý lớn và nhiều tiến trình đồng thời. Hệ thống hỗ trợ các framework AI phổ biến như TensorRT-LLM, vLLM và SGLang, giúp nhà phát triển xây dựng và triển khai các ứng dụng AI agent hiệu quả hơn.

Bên cạnh phần cứng, NVIDIA cũng tích hợp các công cụ phần mềm nhằm đơn giản hóa quá trình xây dựng hệ thống AI agent. Trong đó có NVIDIA NemoClaw, một thành phần thuộc bộ NVIDIA Agent Toolkit, cho phép cài đặt môi trường OpenShell runtime để chạy các agent tự động trong môi trường an toàn.

OpenShell runtime được thiết kế để quản lý các tiến trình agent, xử lý giao tiếp giữa các thành phần và đảm bảo hệ thống hoạt động ổn định khi nhiều agent chạy đồng thời. NVIDIA cũng hỗ trợ các mô hình mã nguồn mở như Nemotron nhằm giúp nhà phát triển thử nghiệm và triển khai AI agent nhanh hơn.

Theo hãng, DGX Spark có khả năng xử lý các workflow yêu cầu cửa sổ ngữ cảnh lớn, mức độ đồng thời cao và khối lượng tác vụ phức tạp. Điều này cho phép các nhóm nghiên cứu và kỹ sư AI xây dựng hệ thống agent ngay trên máy trạm thay vì phụ thuộc hoàn toàn vào hạ tầng điện toán đám mây.

Khả năng mở rộng và tối ưu hiệu năng cho mô hình đến 700B tham số

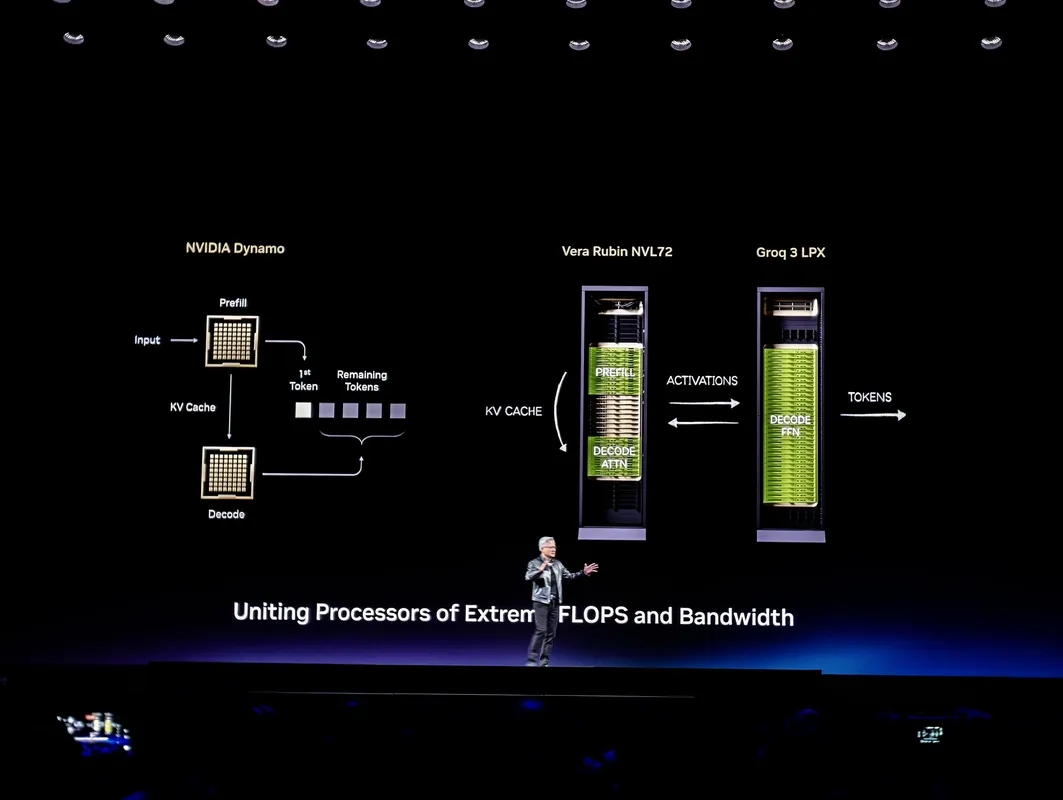

Một điểm đáng chú ý của DGX Spark là khả năng mở rộng hệ thống khi cần xử lý các mô hình AI lớn. NVIDIA cho biết nền tảng này có thể kết nối tối đa bốn node DGX Spark thông qua công nghệ RoCE (RDMA over Converged Ethernet), giúp giảm độ trễ khi truyền dữ liệu giữa các hệ thống.

Nhờ kết nối tốc độ cao, DGX Spark có thể hỗ trợ huấn luyện tinh chỉnh và suy luận cho các mô hình có quy mô lên tới 700 tỉ tham số. Trong các kịch bản như huấn luyện tăng cường (reinforcement learning) hoặc fine-tuning phân tán, hệ thống có thể đạt mức tăng hiệu năng gần tuyến tính khi mở rộng số node, đặc biệt khi giảm thiểu giao tiếp giữa các tiến trình.

NVIDIA cũng giới thiệu các công cụ nhằm tối ưu hiệu năng khi phát triển phần mềm cho DGX Spark. Tile IR và cuTile Python cho phép lập trình viên xây dựng các kernel tính toán có thể chạy trên nhiều kiến trúc GPU khác nhau, từ DGX Spark đến các GPU Blackwell trong trung tâm dữ liệu.

Phân tích hiệu năng theo mô hình roofline cho thấy các kernel có thể tận dụng tốt tài nguyên phần cứng, đồng thời vẫn còn dư địa để tiếp tục tối ưu. Trong các phiên bản tương lai, NVIDIA dự kiến bổ sung cơ chế autotuning tự động cho cuTile, cho phép hệ thống tự tìm cấu hình tối ưu cho từng kiến trúc GPU.

Thông qua DGX Spark, NVIDIA đang hướng tới việc cung cấp một nền tảng máy trạm có thể xử lý các workload AI agent phức tạp ngay tại môi trường phát triển, đồng thời vẫn duy trì khả năng mở rộng lên các hệ thống GPU quy mô lớn trong trung tâm dữ liệu khi cần thiết.