Trong những năm gần đây, thế giới đã chứng kiến hàng loạt cuộc tấn công ransomware nghiêm trọng, bao gồm vụ tấn công vào tập đoàn điện tử tiêu dùng hàng đầu Nhật Bản Casio năm 2024, hay tập đoàn sản xuất chip TSMC và hãng sản xuất máy bay Boeing vào năm 2023. Tại Việt Nam, nhiều tổ chức và doanh nghiệp cũng đã trở thành nạn nhân của ransomware. Những sự cố này không chỉ ảnh hưởng đến uy tín thương hiệu mà còn là hồi chuông cảnh tỉnh đối với nhiều doanh nghiệp về thách thức trong việc bảo vệ dữ liệu.

Trước làn sóng tấn công mạng ngày càng tinh vi và xảy ra liên tục, nhiều tổ chức đã bắt đầu nhận thức rõ hơn về tầm quan trọng của bảo mật dữ liệu, đồng thời chủ động triển khai các biện pháp phòng ngừa. Tuy nhiên, từ góc độ IT, việc bảo vệ toàn diện một khối lượng dữ liệu lớn không phải là nhiệm vụ dễ dàng.

Việc duy trì dữ liệu mỗi ngày có thể trở thành gánh nặng, nhất là khi doanh nghiệp đang vận hành hệ thống kết hợp nhiều phần mềm và phần cứng từ các nhà cung cấp khác nhau. Không ít trường hợp hệ thống không đáp ứng được yêu cầu kiểm toán, hoặc doanh nghiệp khó đảm bảo tính toàn vẹn và chính xác của dữ liệu.

Trong bối cảnh đó, các mô hình thiết bị sao lưu tích hợp giữa phần cứng và phần mềm đang dần trở thành lựa chọn đáng cân nhắc cho doanh nghiệp.

Tái định nghĩa tiêu chuẩn sao lưu: Không chỉ lưu trữ, mà còn phải phục hồi được

Vậy làm sao để doanh nghiệp lựa chọn được giải pháp sao lưu có khả năng phục hồi dữ liệu đúng, đủ và nhanh chóng sau sự cố?

Trước hết, doanh nghiệp cần đảm bảo rằng dữ liệu nguồn có thể được sao lưu nhanh chóng, chính xác và phục hồi hoàn toàn. Với các thiết bị sử dụng công nghệ chống trùng lặp toàn cầu, doanh nghiệp có thể giảm thiểu thời gian sao lưu và băng thông, từ đó cải thiện hiệu suất và đạt được mục tiêu phục hồi dữ liệu (RPO).

Để giảm thiểu tác động của các cuộc tấn công ransomware, doanh nghiệp nên kết hợp giữa sao lưu tại chỗ và sao lưu ngoài hệ thống. Các bản sao lưu này có thể được bảo vệ bằng công nghệ lưu trữ bất biến (immutable) và WORM (Write Once, Read Many), đảm bảo dữ liệu không bị chỉnh sửa hay xóa trong suốt thời gian lưu trữ. Ngoài ra, sao lưu ngoài hệ thống (offsite) còn được mã hóa trước khi truyền đi, đảm bảo dữ liệu được chuyển an toàn đến các vị trí từ xa.

Bên cạnh hiệu suất sao lưu, việc xác thực khả năng phục hồi cũng quan trọng không kém. Doanh nghiệp có thể tạo môi trường sandbox ngay trên thiết bị để kiểm thử kịch bản khôi phục thảm họa mà không ảnh hưởng đến môi trường vận hành.

Đồng thời, có thể kiểm tra các bản sao lưu bằng cách tự động tạo video xác minh khả năng phục hồi khi có sự cố. Các tác vụ phục hồi như khôi phục từng hệ thống, từng tệp hoặc chuyển đổi từ máy vật lý sang ảo (P2V) hoặc từ ảo sang ảo (V2V) đều có thể được thực hiện linh hoạt tùy theo mục tiêu khôi phục (RTO) khi bị ransomware tấn công.

Bảo vệ dữ liệu sạch: Tư duy mới trong kỷ nguyên ransomware

Không nên tin rằng máy chủ sao lưu là vùng an toàn tuyệt đối. Các giải pháp sao lưu hiện đại với kiến trúc bảo mật toàn diện thường tập trung vào ba yếu tố chính:

- Phân quyền theo vai trò, giúp kiểm soát chính xác ai được phép truy cập, ai không, đảm bảo mỗi người dùng chỉ có quyền phù hợp với vai trò của họ trong tổ chức.

- Chặn truy cập trái phép qua IP bằng cách giới hạn quyền truy cập vào thiết bị sao lưu, chỉ cho các địa chỉ IP đã được cấp phép, qua đó giảm nguy cơ truy cập trái phép hoặc tấn công từ bên ngoài.

- Sao lưu ngoại tuyến, cách ly máy chủ khỏi mạng khi không cần thiết. Ngoài chiến lược sao lưu 3-2-1 (ba bản sao, trên hai loại phương tiện, trong đó một bản offsite), doanh nghiệp có thể bổ sung thêm một bản copy ngoại tuyến, từ đó bảo toàn bản sao sạch, sẵn sàng phục hồi khi có sự cố.

Quản lý tập trung, nâng cao hiệu suất vận hành

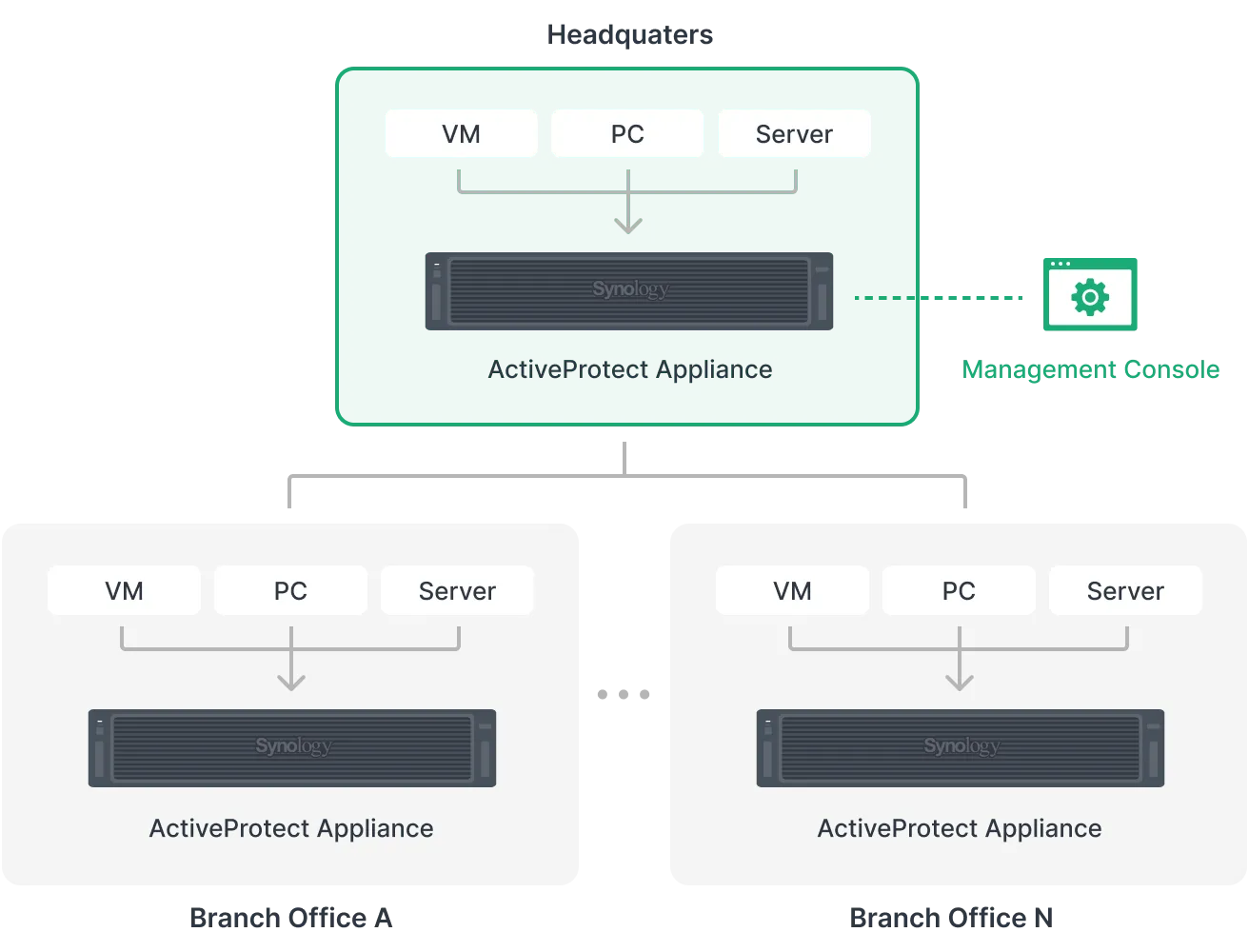

Với các doanh nghiệp có nhiều chi nhánh, việc quản lý sao lưu phân tán thường tạo ra lỗ hổng. Khi sự cố xảy ra tại một chi nhánh, nếu không có cái nhìn tổng thể, đội ngũ IT rất khó phản ứng kịp thời.

Một số thiết bị sao lưu hiện nay đã hỗ trợ quản lý tập trung, chẳng hạn như ActiveProtect, cho phép giám sát quản lý tới 2.500 máy chủ và 150.000 khối lượng công việc từ một bảng điều khiển duy nhất. Nhờ đó, việc phát hiện sự cố, kiểm tra tình trạng máy chủ và phục hồi dữ liệu từ xa trở nên dễ dàng hơn, giúp doanh nghiệp duy trì liên tục hoạt động, kể cả khi gặp sự cố nghiêm trọng tại một điểm nào đó.

Kết luận

Để đối phó với các mối đe dọa ngày càng gia tăng, doanh nghiệp cần xây dựng một chiến lược bảo vệ dữ liệu toàn diện, không chỉ dựa vào một giải pháp đơn lẻ. Những giải pháp như ActiveProtect của Synology đang giúp các tổ chức giảm thiểu khối lượng công việc thủ công, chuẩn hóa quy trình sao lưu và phục hồi, tiết kiệm thời gian đồng thời đảm bảo khả năng vận hành liên tục.

Với một chiến lược an ninh vững chắc và giải pháp sao lưu hiệu quả, doanh nghiệp có thể an tâm bảo vệ tài sản số và duy trì hoạt động trong mọi tình huống, đặc biệt là khi đối mặt với các cuộc tấn công ransomware.

Trong khi đó, game thủ sẽ đắm chìm trong thế giới game với đồ hoạ đỉnh cao nhờ hiệu năng mạnh mẽ từ card đồ hoạ RTX 5090, đi kèm công nghệ tiên tiến như DLSS 4 và Multi Frame Generation. Sự kết hợp này mang lại hình ảnh siêu mượt, tốc độ khung hình cao và khả năng xử lý vượt trội ngay cả ở những tựa game nặng nhất — đưa trải nghiệm chơi game lên một tầm cao mới.

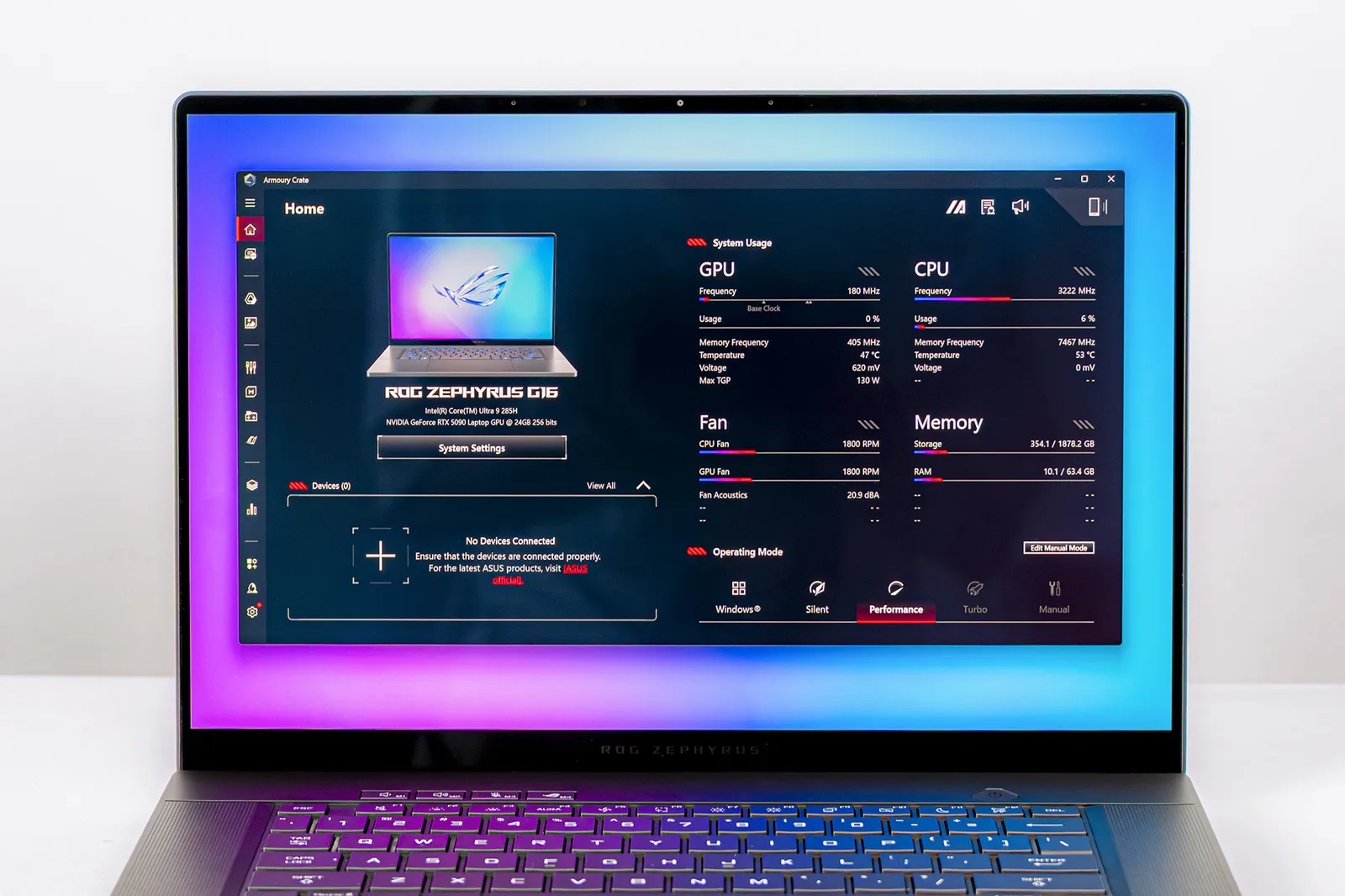

Trong khi đó, game thủ sẽ đắm chìm trong thế giới game với đồ hoạ đỉnh cao nhờ hiệu năng mạnh mẽ từ card đồ hoạ RTX 5090, đi kèm công nghệ tiên tiến như DLSS 4 và Multi Frame Generation. Sự kết hợp này mang lại hình ảnh siêu mượt, tốc độ khung hình cao và khả năng xử lý vượt trội ngay cả ở những tựa game nặng nhất — đưa trải nghiệm chơi game lên một tầm cao mới. ROG Zephyrus G16 2025 còn mang đến tùy chọn cấu hình RAM lên đến 64GB cho phép xử lý các tác vụ đặt thù yêu cầu nhiều bộ nhớ, đa nhiệm hiệu quả và làm việc trong nhiều giờ mà không gặp tình trạng giật, lag do thiếu bộ nhớ. Cùng với các tùy chọn CPU và GPU cao cấp, ROG Zephyrus G16 là lựa chọn hoàn hảo những ai cần laptop gaming mạnh mẽ nhưng vẫn mỏng nhẹ.

ROG Zephyrus G16 2025 còn mang đến tùy chọn cấu hình RAM lên đến 64GB cho phép xử lý các tác vụ đặt thù yêu cầu nhiều bộ nhớ, đa nhiệm hiệu quả và làm việc trong nhiều giờ mà không gặp tình trạng giật, lag do thiếu bộ nhớ. Cùng với các tùy chọn CPU và GPU cao cấp, ROG Zephyrus G16 là lựa chọn hoàn hảo những ai cần laptop gaming mạnh mẽ nhưng vẫn mỏng nhẹ. Bên cạnh công nghệ chống xé hình G-Sync và tốc độ phản hồi siêu nhanh 0.2ms cho hình ảnh chuyển động rõ nét, màn hình của máy cũng đạt chuẩn Pantone với DeltaE < 1 giúp đảm bảo nội dung luôn chân thực đến đừng khoảnh khắc. Đây chính là màn hình hoàn hảo cho các game thủ và nhà sáng tạo nội dung. Kết hợp cùng màn hình đẹp, ROG Zephyrus G16 còn được trang bị hệ thống 6 loa cao cấp hỗ trợ âm thanh vòm Dolby Atmos, mang đến trải nghiệm âm thanh sống động, chân thực – thuộc hàng tốt nhất trong thế giới laptop Windows hiện nay.

Bên cạnh công nghệ chống xé hình G-Sync và tốc độ phản hồi siêu nhanh 0.2ms cho hình ảnh chuyển động rõ nét, màn hình của máy cũng đạt chuẩn Pantone với DeltaE < 1 giúp đảm bảo nội dung luôn chân thực đến đừng khoảnh khắc. Đây chính là màn hình hoàn hảo cho các game thủ và nhà sáng tạo nội dung. Kết hợp cùng màn hình đẹp, ROG Zephyrus G16 còn được trang bị hệ thống 6 loa cao cấp hỗ trợ âm thanh vòm Dolby Atmos, mang đến trải nghiệm âm thanh sống động, chân thực – thuộc hàng tốt nhất trong thế giới laptop Windows hiện nay. Tô điểm cho sự mỏng nhẹ là thiết kế thanh thoát, kết hợp cùng dải Slash Lighting trên nắp máy tạo nên điểm nhấn đầy cuốn hút – vừa mang đậm dấu ấn riêng của dòng ROG, vừa thể hiện sự cá tính và khác biệt. Không chỉ gây ấn tượng cho game thủ nhờ hiệu năng mạnh mẽ, ROG Zephyrus G16 sẵn sàng thu hút mọi ánh nhìn với thiết kế cao cấp sang trọng của mình.

Tô điểm cho sự mỏng nhẹ là thiết kế thanh thoát, kết hợp cùng dải Slash Lighting trên nắp máy tạo nên điểm nhấn đầy cuốn hút – vừa mang đậm dấu ấn riêng của dòng ROG, vừa thể hiện sự cá tính và khác biệt. Không chỉ gây ấn tượng cho game thủ nhờ hiệu năng mạnh mẽ, ROG Zephyrus G16 sẵn sàng thu hút mọi ánh nhìn với thiết kế cao cấp sang trọng của mình.