GPU AMD Instinct MI355X đạt hơn 1 triệu token/giây tại MLPerf 6.0, khẳng định sức mạnh xử lý suy luận AI và khả năng mở rộng hệ thống đa nút.

Tập đoàn AMD vừa công bố kết quả đánh giá MLPerf Inference 6.0, ghi nhận bước tiến kỹ thuật quan trọng của dòng vi xử lý đồ họa (GPU) Instinct MI355X. Phần cứng mới được xây dựng dựa trên kiến trúc CDNA 4 tiên tiến, sử dụng tiến trình 3nm với 185 tỷ bóng bán dẫn. Thiết bị hỗ trợ nguyên bản các định dạng dữ liệu FP4, FP6 và tích hợp cấu trúc bộ nhớ HBM3E dung lượng lên đến 288GB. Nền tảng được thiết kế theo tiêu chuẩn UBB8, cung cấp các tùy chọn tản nhiệt bằng không khí hoặc chất lỏng trực tiếp, tối ưu hóa không gian triển khai cho các mô hình ngôn ngữ lớn và hệ thống máy chủ suy luận hiệu năng cao.

Đột phá hiệu năng và khả năng xử lý đa mô hình

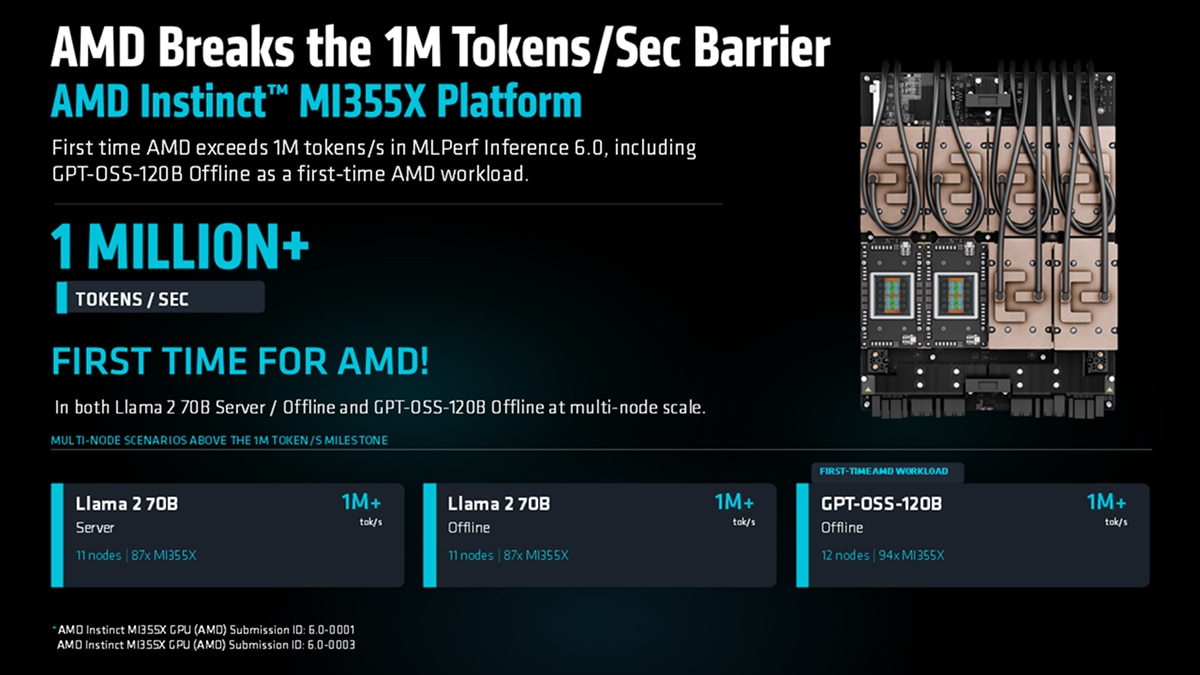

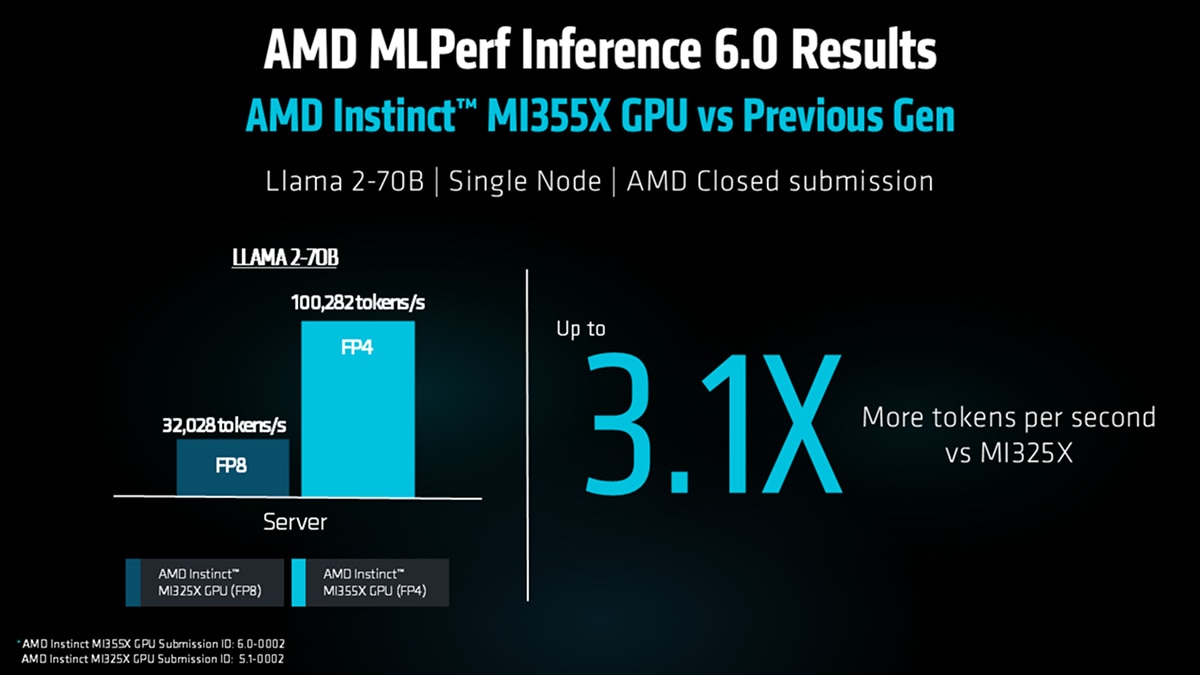

Tại vòng thử nghiệm này, hệ thống máy chủ trang bị GPU MI355X chính thức vượt qua ngưỡng 1 triệu token/giây. Thành tích này được thiết lập trên mô hình Llama 2 70B và GPT-OSS-120B ở quy mô đa nút. Hiệu suất xử lý của phiên bản mới cao gấp 3,1 lần so với thế hệ MI325X tiền nhiệm ra mắt cách đây sáu tháng. Khi đối chiếu trực tiếp với phần cứng đối thủ, nền tảng của AMD thể hiện sức mạnh cạnh tranh sòng phẳng.

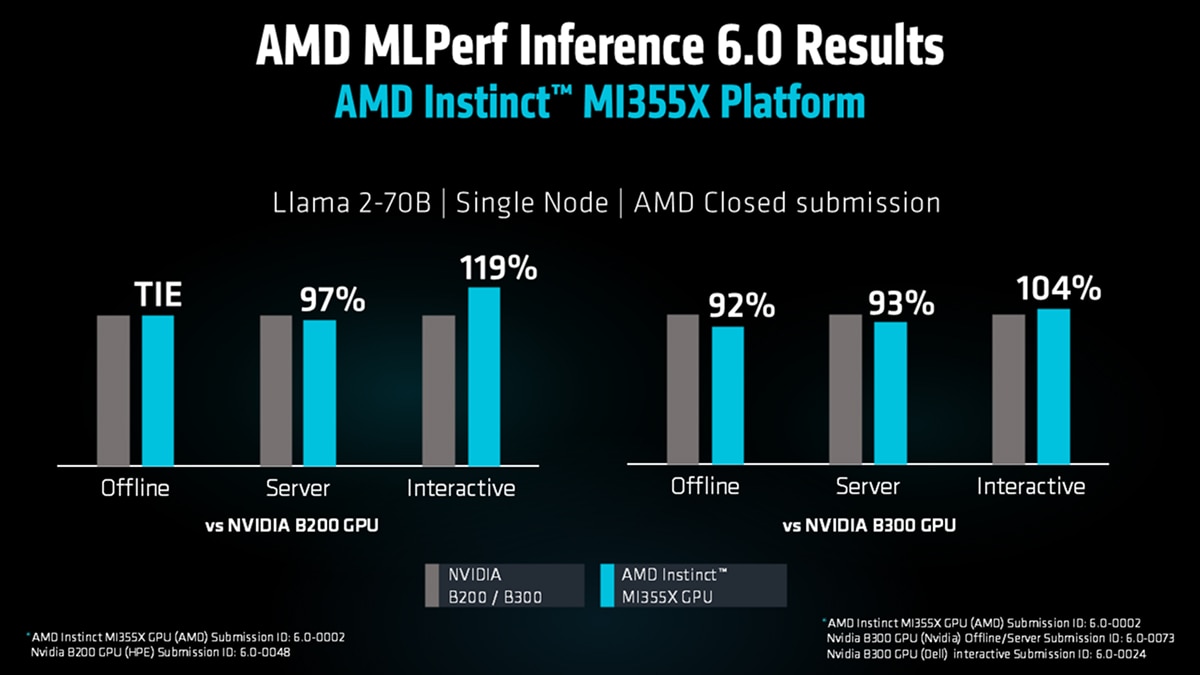

Trên mô hình Llama 2 70B, hệ thống MI355X đơn nút đạt hiệu suất tương đương 97% bài kiểm tra Server và 119% bài kiểm tra Interactive của thiết bị Nvidia B200, đồng thời duy trì khoảng cách sát sao với mẫu B300 cao cấp. Bên cạnh các mô hình ngôn ngữ lớn quen thuộc, AMD mở rộng phạm vi đánh giá sang tác vụ trí tuệ nhân tạo tạo sinh video với mô hình Wan-2.2-t2v. Hệ thống ghi nhận mức hiệu năng đạt 93% so với B200 ở hạng mục Single Stream ngay trong đợt chạy thử nghiệm đầu tiên.

Tối ưu hóa mở rộng cụm máy chủ và kết nối đa nút

Khả năng duy trì hiệu suất khi mở rộng quy mô cụm máy chủ là điểm nhấn kỹ thuật quan trọng thứ hai. Đối với bài kiểm tra Llama 2 70B, nhà sản xuất cấu hình thành công cụm 11 nút chứa 87 GPU MI355X, mang lại kết quả 1.042.110 token/giây ở hạng mục Offline. Hệ thống duy trì mức hiệu suất mở rộng tuyến tính đạt 93% ở hạng mục Server. Đối với mô hình GPT-OSS-120B, cụm 12 nút tích hợp 94 GPU cũng đạt tỷ lệ hiệu quả 93%, chứng minh khả năng ổn định sức mạnh tính toán khi gia tăng số lượng thiết bị phần cứng.

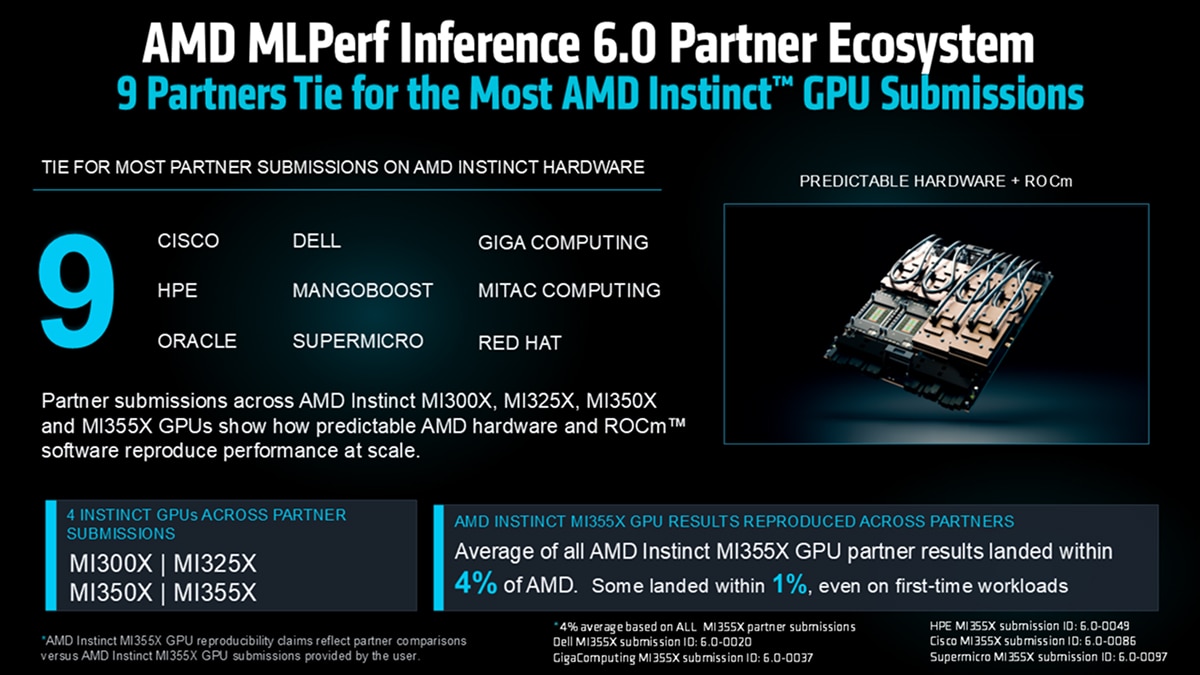

Hệ sinh thái đối tác phần cứng của hãng thể hiện sự đồng bộ cao khi 9 nhà sản xuất lớn như Dell, Supermicro, HPE tham gia đánh giá độc lập và tái tạo kết quả với độ lệch chỉ dao động từ 1% đến 4%. Nổi bật nhất, Dell và MangoBoost thiết lập thành công hệ thống máy chủ suy luận hỗn hợp đầu tiên, kết hợp ba dải sản phẩm GPU MI300X, MI325X và MI355X đặt tại hai trung tâm dữ liệu cách biệt địa lý ở Mỹ và Hàn Quốc.

Tầm quan trọng của nền tảng ROCm và định hướng tương lai

Toàn bộ cụm hệ thống phần cứng được điều phối và tối ưu hóa triệt để thông qua bộ công cụ phần mềm ROCm. Nền tảng này trực tiếp hỗ trợ thực thi định dạng khối dữ liệu FP4, quản lý hệ thống giao tiếp băng thông rộng giữa các GPU và phân bổ khối lượng công việc linh hoạt trên cụm máy chủ không đồng nhất. Kết quả từ hệ thống đánh giá MLPerf 6.0 củng cố tính khả thi của lộ trình phát hành thiết bị thường niên do hãng đề ra.

Nhằm đáp ứng nhu cầu tăng trưởng mạnh mẽ của cơ sở hạ tầng trí tuệ nhân tạo, nhà sản xuất bán dẫn lên kế hoạch trình làng dòng sản phẩm Instinct MI400 dựa trên vi kiến trúc CDNA 5 vào năm 2026. Thế hệ phần cứng mới sẽ đóng vai trò trung tâm xử lý cho nền tảng máy chủ quy mô tủ mạng AMD Helios, định hình cấu trúc trung tâm dữ liệu AI thương mại trong giai đoạn tiếp theo.